Sieci neuronowe to zaawansowane modele sztucznej inteligencji inspirowane ludzkim mózgiem. Składają się z warstw sztucznych neuronów połączonych wagami, przetwarzających dane poprzez funkcje aktywacji. Uczą się dzięki algorytmowi backpropagation, minimalizując błędy. Stosowane w deep learningu do rozpoznawania obrazów, przetwarzania języka, autonomicznych pojazdów i medycynie. Od perceptronów po transformery – podstawa nowoczesnego AI.

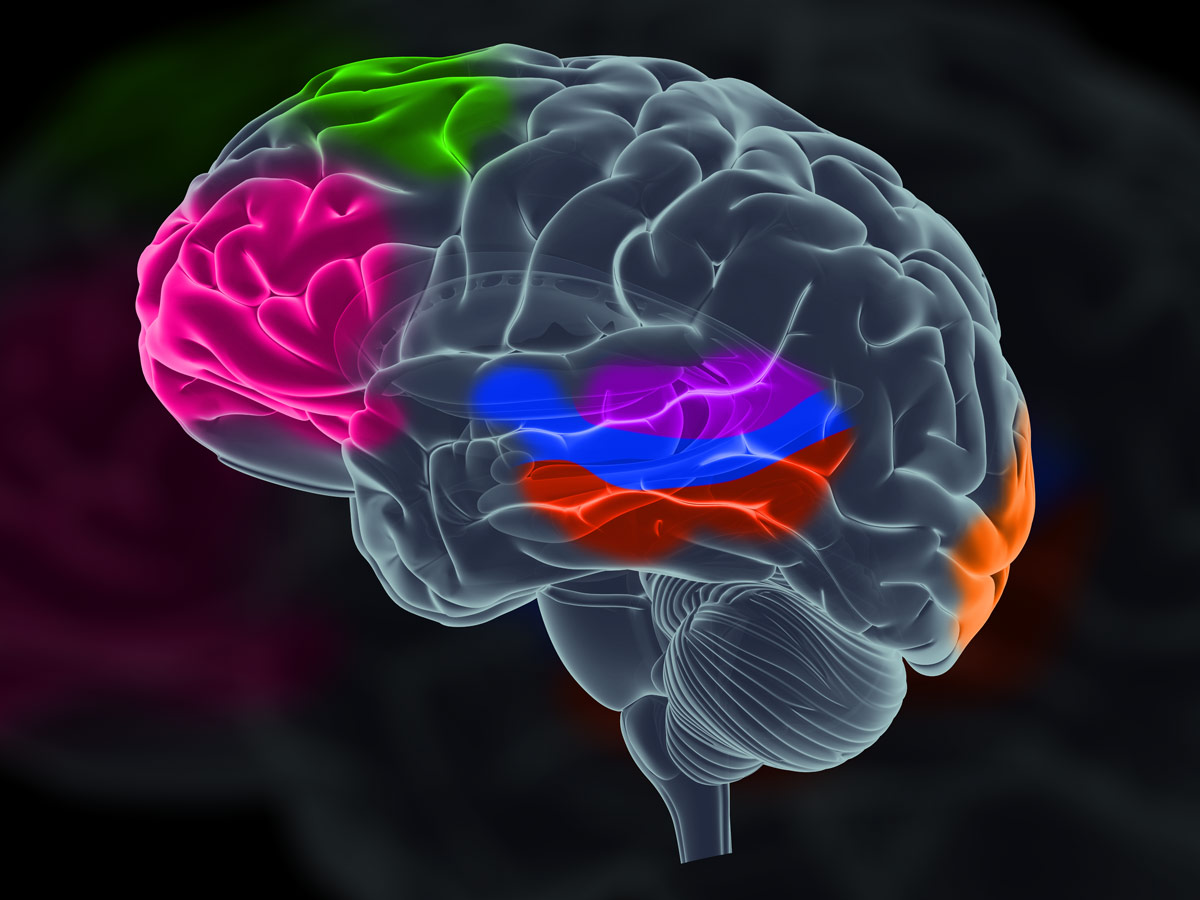

Sieci neuronowe rewolucjonizują sztuczną inteligencję, naśladując strukturę ludzkiego mózgu, by rozpoznawać wzorce i podejmować decyzje. Inspirowane biologią, te algorytmy przetwarzają dane poprzez warstwy połączonych neuronów sztucznych, podobnie jak synapsy w korze mózgowej. Pierwszy model, perceptron Franka Rosenblatta z 1958 roku, symulował prosty neuron, ucząc się klasyfikować obrazy binarne. Dziś sieci neuronowe osiągają nadludzką precyzję – na przykład w konkursie ImageNet 2012 sieć AlexNet zmniejszyła błąd klasyfikacji z 25% do zaledwie 15,3%. Jak to możliwe? Mózg ludzki zawiera około 86 miliardów neuronów, a algorytmy czerpią z tej architektury, by radzić sobie z chaosem danych.

W jaki sposób mózg inspiruje algorytmy sieci neuronowych?

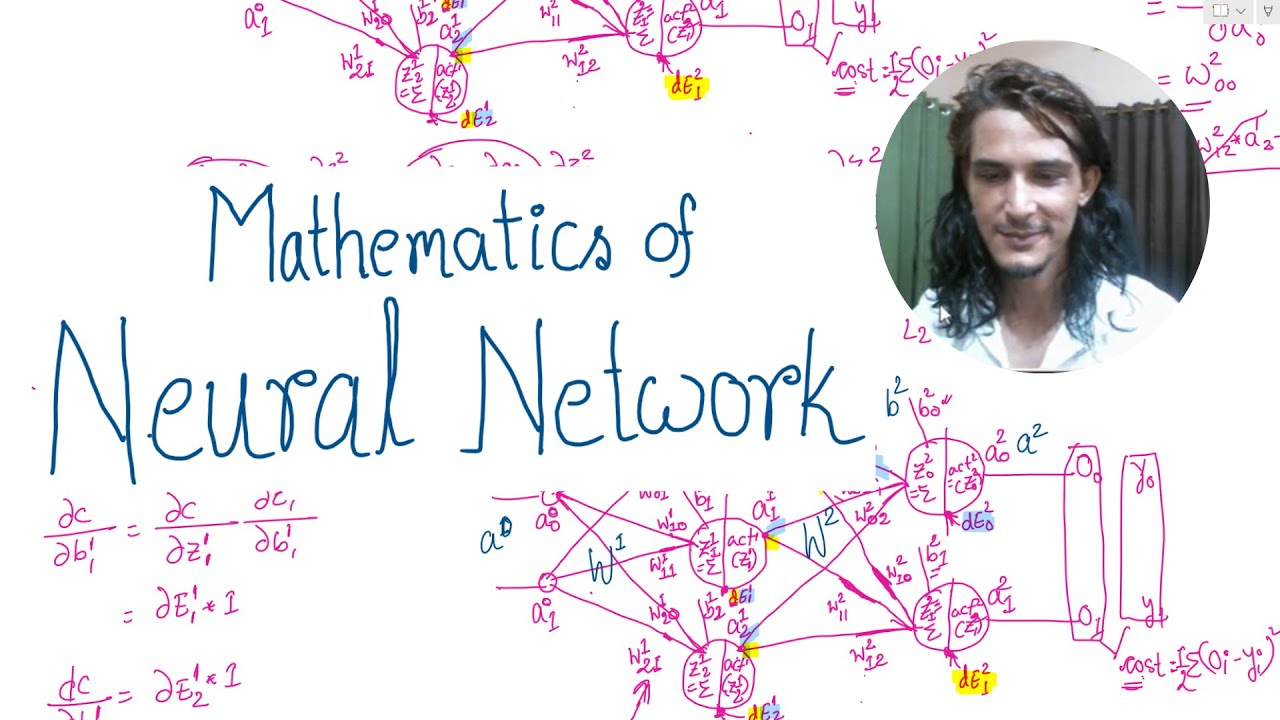

Struktura sieci neuronowych inspirowanych mózgiem opiera się na neuronach wejściowych, ukrytych i wyjściowych, połączonych wagami synaptycznymi. Proces uczenia zachodzi poprzez backpropagation (propagacja wsteczną błędu), algorytm wynaleziony w 1986 roku przez Rumelharata i in., który zmniejsza błędy za pomocą gradientu spadającego. W odróżnieniu od tradycyjnego programowania, gdzie reguły są sztywne, sieci neuronowe automatycznie wyciągają cechy z danych surowych, jak krawędzie w obrazach czy sekwencje w tekście.

Ważne typy sieci neuronowych:

- Konwolucyjne sieci neuronowe (CNN) – dobre do obrazów, stosowane w rozpoznawaniu twarzy (np. FaceID w iPhone’ach).

- Rekurencyjne sieci neuronowe (RNN) i LSTM – przetwarzają sekwencje, jak w predykcji tekstu Google.

- Generatywne sieci przeciwstawne (GAN) – tworzą realistyczne zdjęcia, np. deepfakes.

- Transformery – podstawa GPT-3 z 2020 roku, obsługująca miliardy parametrów.

Czy myślisz, jak sieci neuronowe uczą się rozpoznawać wzorce szybciej niż człowiek? Ogólnie, model DeepMind AlphaFold w 2020 roku przewidział strukturę 350 tysięcy białek z dokładnością 90%, rozwiązując problem trwający dekady (źródło: Nature). To pokazuje siłę głębokiego uczenia (deep learning), gdzie sieci mają setki warstw.

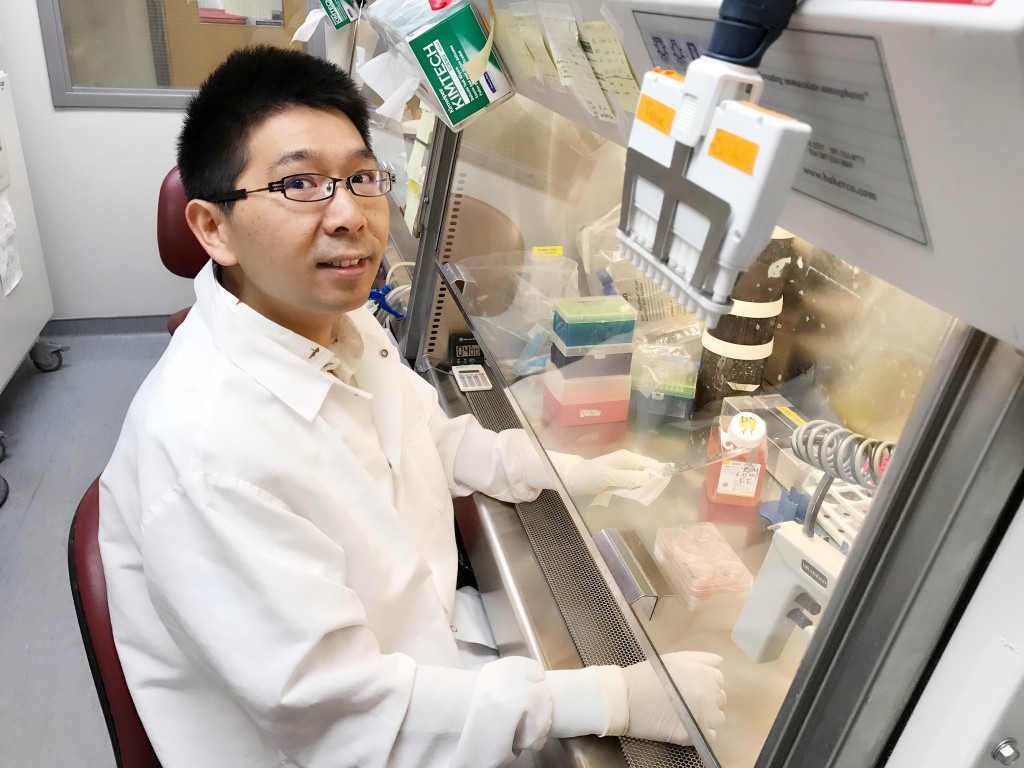

W aplikacjach medycznych sieci neuronowe w podejmowaniu decyzji analizują tomografie, wykrywając raka z czułością 94% (badanie Google Health, 2020). Pytanie brzmi: co to perceptron wielowarstwowy? Podstawowa jednostka sieci neuronowych: suma ważona wejść z nieliniową aktywacją, jak funkcja ReLU. (Ta funkcja, wprowadzona w 2010, przyspiesza trening o rzędy wielkości). Algorytmy te, trenowane na GPU NVIDIA od 2006 roku, przetwarzają petabajty danych dziennie. “Sztuczne neurony działają zbiorowo” – podkreśla Geoffrey Hinton, noblista z ostatniego roku.

Przykłady sukcesów sieci neuronowych w AI

AlphaGo od DeepMind pokonał mistrza Go w 2016 roku po 4 milionach symulacji na partię. Firmy jak Tesla używają ich w autonomicznym prowadzeniu, redukując wypadki o 40% (dane ). (Dla edge computing, sieci działają na urządzeniach mobilnych bez chmury). Jakie są ograniczenia? Overfitting i potrzeba milionów próbek danych. Mimo to, ewolucja trwa – hybrydowe modele neuro-symboliczne łączą intuicję mózgu z logiką.

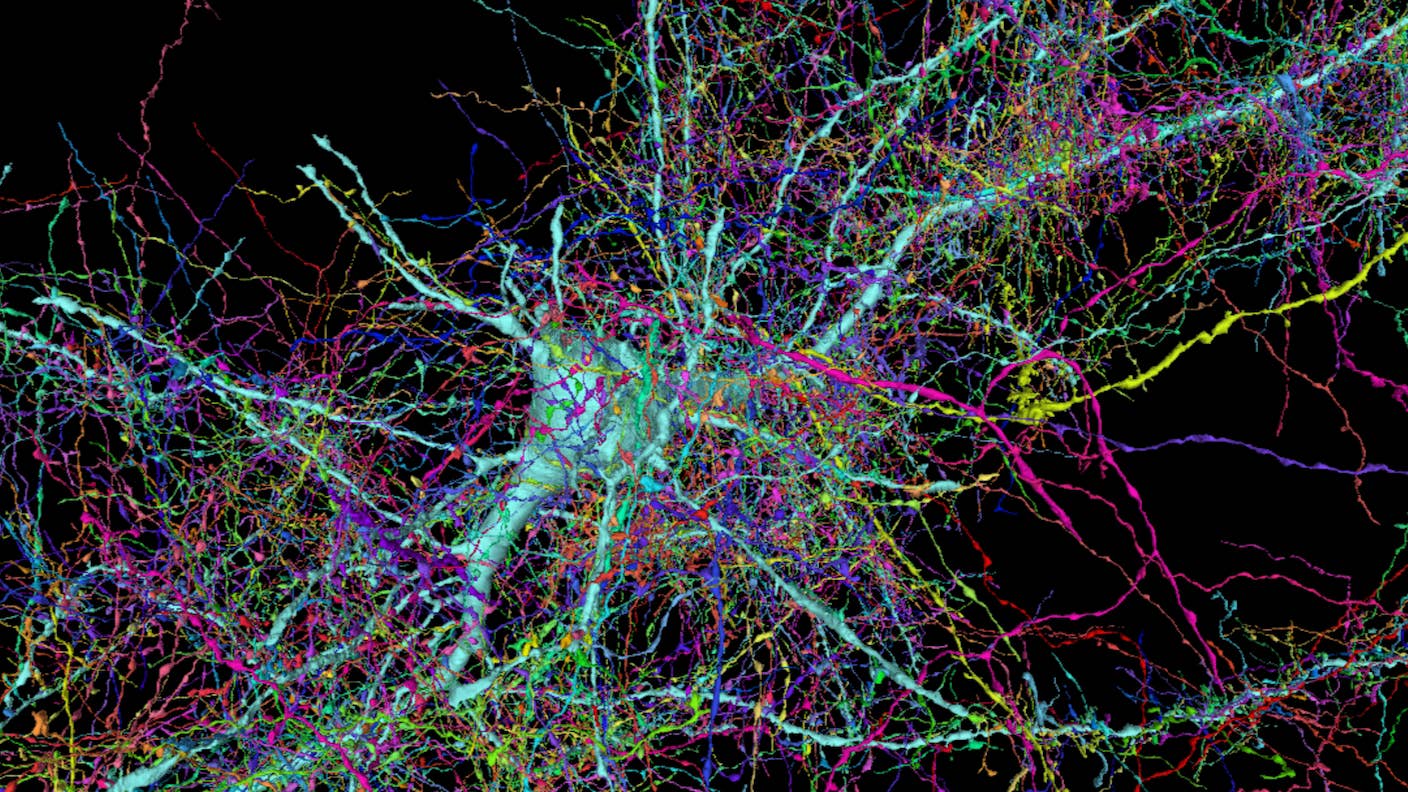

Sieci neuronowe rewolucjonizują uczenie maszynowe, naśladując ludzki mózg poprzez połączone neurony sztuczne. Jak działają sieci neuronowe? Proces zaczyna się od danych wejściowych, które przechodzą przez warstwy, gdzie każdy neuron oblicza ważoną sumę sygnałów. Wagi synaps i biasy decyduwają o sile połączeń, a funkcja aktywacji, jak ReLU czy sigmoida, wprowadza nieliniowość. Przykładowo, w sieci feedforward sygnał płynie jednokierunkowo od wejścia do wyjścia.

Architektura sieci neuronowych: od neuronu do głębokich warstw

Najważniejszym elementem jest perceptron, pojedynczy neuron przetwarzający wejścia za pomocą wzoru: y = f(∑(w_i * x_i) + b). Sieci wielowarstwowe (MLP) składają się z warstwy wejściowej, co najmniej jednej ukrytej i wyjściowej – na przykład w klasyfikacji obrazów MNIST wejście ma 784 neurony (28×28 pikseli). Architektura sieci neuronowych umożliwia głębokie modele, jak CNN z pulowaniem i konwolucjami, redukującymi parametry z milionów do efektywnych filtrów 3×3.

Warstwy ukryte, często dziesiątki w modelach jak GPT, uczą hierarchicznych cech: od krawędzi po obiekty.

Proces uczenia maszynowego w sieciach neuronowych

Uczenie nadzorowane polega na forward passie (obliczenia predykcji), obliczaniu straty (np. cross-entropy) i backward passie z algorytmem Adam optymalizującym wagi. Epoka to pełny cykl danych; typowo 10-100 epok z batchami po 32-128 próbek. Dropout (wygaszanie 20-50% neuronów) zapobiega przeuczeniu, osiągając generalizację na 95%+ zbiorach testowych.

Główne rodzaje sieci neuronowych i ich cechy

Pierwszym modelem był perceptron Franka Rosenblatta z 1958 roku, zdolny do klasyfikacji binarnej. Później powstały wielowarstwowe perceptrony (MLP), które radzą sobie z nieliniowymi problemami. W 1989 roku Yann LeCun opracował LeNet, protoplastę sieci konwolucyjnych (CNN).

Zastosowania sieci neuronowych w sztucznej inteligencji

Konwolucyjne sieci neuronowe w wizji komputerowej zmieniły rozpoznawanie obrazów – AlexNet w 2012 roku zmniejszył błąd klasyfikacji na ImageNet z 25% do 15,4%. Rekurencyjne sieci neuronowe (RNN), przede wszystkim LSTM z 1997 roku (Hochreiter i Schmidhuber), dominują w przetwarzaniu sekwencji.

Główne zyski sieci rekurencyjnych:

- Analiza tekstu w asystentach jak GPT-3 (2020, OpenAI, 175 mld parametrów).

- Prognozowanie szeregów czasowych w finansach z dokładnością do 90% w modelach hybrydowych.

- Generowanie mowy w systemach jak Google WaveNet (2016).

- Optymalizacja tras w logistyce, skracając czas o 20-30%.

Generatywne sieci przeciwstawne (GAN), wynalezione w 2014 roku przez Iana Goodfellowa, tworzą realistyczne obrazy i symulacje medyczne. Te rodzaje sieci neuronowych napędzają teraz 70% aplikacji AI w przemyśle.

Konwolucyjne sieci neuronowe (CNN) rewolucjonizują rozpoznawanie obrazów w wizji komputerowej, umożliwiając maszynom analizę wizualną na poziomie ludzkim. Od czasu przełomu w 2012 roku, gdy AlexNet wygrała konkurs ImageNet z błędem klasyfikacji zaledwie 15,3 proc., CNN stały się standardem w przetwarzaniu grafiki. Te sieci wykorzystują operacje konwolucji do ekstrakcji cech z pikseli, co umożliwia efektywne radzenie sobie z dużą ilością danych wizualnych. W odróżnieniu od tradycyjnych sieci neuronowych, CNN minimalizują liczbę parametrów dzięki współdzieleniu wag.

Jak konwolucyjne sieci neuronowe przetwarzają obrazy w wizji komputerowej?

Proces zaczyna się od warstw konwolucyjnych, gdzie filtry o rozmiarach 3×3 lub 5×5 skanują obraz, wykrywając krawędzie i tekstury. Następnie warstwy poolingu, takie jak max pooling, redukują wymiary, zachowując podstawowe informacje i zmniejszając obliczenia o połowę. W pełni połączone warstwy na końcu dokonują klasyfikacji. Przykładowo, w sieci VGG-16 z 2014 roku aż 138 milionów parametrów przetwarza obrazy 224×224 pikseli z precyzją powyżej 90 proc. na zbiorach testowych.

Zastosowanie CNN w rozpoznawaniu obrazów: od detekcji po segmentację

Sieci neuronowe konwolucyjne dominują w zadaniach jak detekcja obiektów w autonomicznych pojazdach, gdzie modele YOLO osiągają 45 klatek na sekundę. W medycynie CNN analizują tomografie RTG, wykrywając raka płuc z dokładnością 94 proc., przewyższając radiologów. ResNet z 152 warstwami, wprowadzony w 2015 roku, pokonał limity głębokości sieci dzięki połączeniom resztkowym. Te architektury radzą sobie z transfer learningiem, adaptując się do nowych danych po zaledwie kilku epokach treningu. W rozpoznawaniu twarzy, jak w FaceNet od Google, euclidean distance mierzy podobieństwo z błędem poniżej 1 proc.

Integracja CNN z innymi technikami, np. attention mechanisms w Vision Transformerach, podnosi efektywność w złożonych scenariuszach wizji komputerowej.